「霊長類の動画を見続けますか」FBのAIが黒人男性を誤認識

自動でカテゴリを判定するAIが誤って黒人男性の動画を「霊長類」と判断した件について、Facebookは「受け入れがたいエラー」と謝罪し、再発防止のために検証を行うと発表しました。

確かにヒトも霊長類だが……

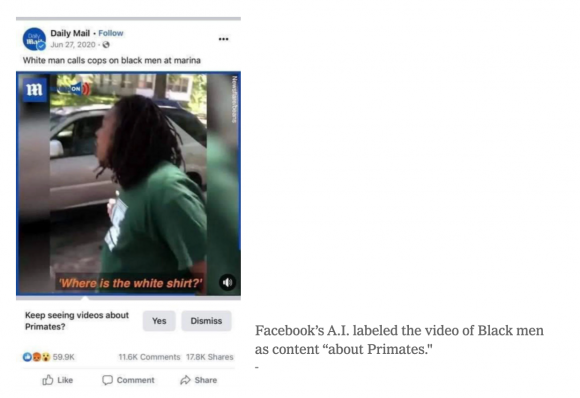

事件の発端は、英メディアDaily Mailが6月27日に投稿した動画を視聴したユーザーに対して、Facebookが「霊長類に関するビデオを見続けますか」という自動メッセージを表示したことです。動画には、白人の一般市民や警察官とトラブルになっている黒人男性が映っており、一般的に猿をイメージする「霊長類」とは関連性のない内容でした(厳密にはヒト科も霊長類の分類群です)。

この画像を友人経由で回覧したのが、Facebookの元コンテンツデザインマネージャーのダーシー・グローブス氏です。「恐ろしくてひどい」と感じた彼女は、すぐに現役・元社員向けのフィードバックフォーラムに投稿、本社にも問題が共有されることとなります。

事態を重くみたFacebookは自動メッセージを表示する原因となったAI機能を無効にし、「受け入れられない」問題であり、根本的な原因を調査中だとコメントを発表しました。

テック企業で頻発するAIの暴走

AIを使って訓練されたアルゴリズムが人種的に偏っていることを示す例は、残念ながら枚挙に暇がありません。

2015年にGoogleが黒人の画像に対して「ゴリラ」とタグ付けしたのをきっかけに、世間でも広く共有されるようになったこの問題は、2020年にもTwitterで白人男性が優先表示される仕様が発覚したように、未だに企業を悩ませユーザーを怒らせる原因となっています。

先述したFacebook元マネージャーのダーシー・グローブス氏も「いつまでもミスを犯しては『ごめんなさい』と謝り続けることはできない」と批判、人種問題に対して今まで以上にしっかり向き合うべきだと指摘しています。

Source:The Verge,NYT

(kihachi)