Google の「AutoML Vision」で盛り付けからラーメン二郎の店舗がわかる!

Googleが1月下旬に発表した「Cloud AutoML Vision」で、専門知識がなくても比較的簡単に機械学習モデルが構築できるようになりました。その実力を検証するため、データサイエンティストの土井賢治さんが、41店舗あるラーメン二郎の盛り付けのされ方から店舗を見分けられるか実験を行ないました。

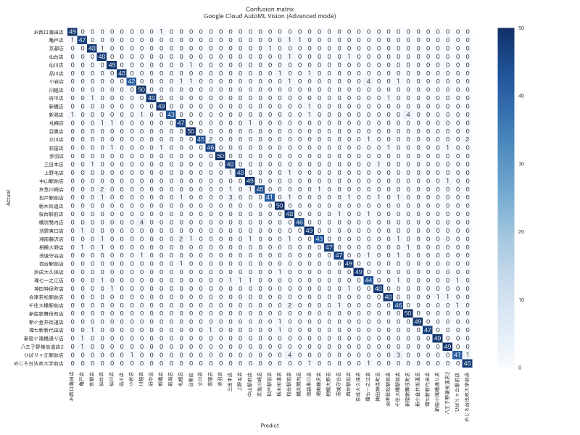

95%の精度で店舗を特定!

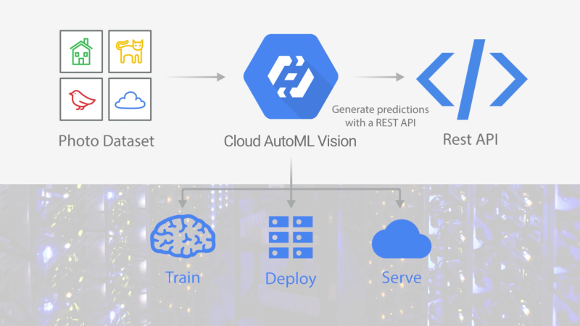

Googleの「Cloud AutoML Vision」は、機械学習モデルを任意の画像を使って容易に行なうことができる新サービスです。使い方は簡単で、機械学習モデルに学習させたい画像ファイルとラベルをサービスにアップロードするだけです。

一度、学習が終了すると、機械学習モデルをプラットフォーム上ですでに使用開始することができます。

土井さんは、AutoML Visionの実力を試すため、ラーメン二郎の画像をインターネットで収集しました。その数、なんと48,244枚にのぼります。集めた写真のうち、機械学習モデルに適さない、重複したものや、どんぶりが含まれていないものを排除し、1,170枚 x 41店舗の合計約48,000枚の画像と、店舗名のラベルを準備しました。

出来上がった機械学習モデルをテストしてみたところ、その精度は94.5%に達した模様です。機械学習モデルが正確に何を見て画像を見分けているかはわからなかったようですが、おそらく「店舗ごとの盛り付け方」や「肉の切り方の微妙の違い」と見分けたのだろうと土井さんは推測しているようです。

Source:Google Cloud JP

(lexi)